Le SEO, vous connaissez ? L’optimisation des sites Internet pour les moteurs de recherche, c’est un faisceau d’outils et de bonnes pratiques née dès l’essor du web. Mais depuis 2 ans on parle de plus en plus de GEO – ou l’optimisation pour les moteurs de réponses et autres LLM. Entre SEO et GEO, les liens sont étroits, les différences ténues.

Le 23 avril, nous avions le plaisir d’écouter Delphine Anquetil, responsable des produits numériques à la Philharmonie de Paris. Récemment commanditaire d’un audit SEO/GEO de son site, elle partage ses apprentissages, ses surprises, ses questionnements, dans cet échange modéré par Roxane Tchernia, membre du TMNlab.

Une session ponctuée par plusieurs questions : quelles pratiques SEO/GEO sont prioritaires ? comment gérer les ressources nécessaires ? faut-il une version MD de son site web ? les mots clés ont-ils encore un sens ? comment éditorialiser pour un meilleur référencement SEO/GEO et est-ce compatible avec un site de lieu de spectacle vivant ? comment mesurer l’efficacité de ses actions ?

Réécoutez l’enregistrement du Café

Compte-rendu détaillé

Cette partie a été générée avec deux outils IA :

l’un pour la transcription de l’enregistrement, l’autre pour l’analyse et le résumé. Et à chaque étape, un humain à la manœuvre.

Le constat de Delphine Anquetil, responsable des produits numériques à la Philharmonie de Paris, est sans ambiguïté : le GEO ne remplace pas le SEO, il le complexifie. L’arrivée des IA génératives modifie profondément les conditions de visibilité des contenus. Il ne s’agit plus seulement d’être bien positionné dans les moteurs de recherche classiques, mais aussi d’être identifié, cité et mobilisé dans les réponses générées directement par les assistants IA.

Ce café TMNlab aborde les conséquences techniques, éditoriales, organisationnelles et stratégiques de cette évolution des pratiques de référencement dans un environnement où les IA génératives deviennent des intermédiaires majeurs d’accès à l’information.

Contexte de l’audit SEO/GEO et premiers constats

L’institution travaille le SEO depuis plusieurs années, car il constitue sa première source de trafic et revêt donc une importance stratégique majeure. Plusieurs audits SEO avaient déjà été réalisés par le passé, complétés par des outils automatiques de surveillance, l’usage de la Search Console et la mise en place de données structurées sur les événements, concerts, spectacles et autres contenus.

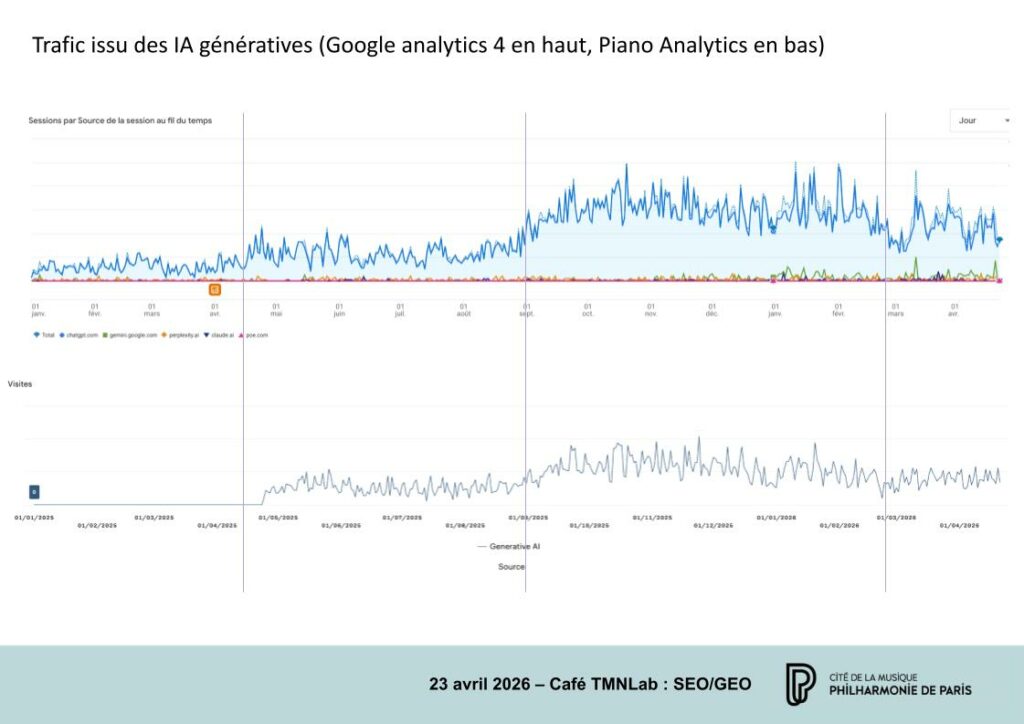

L’arrivée des IA génératives comme source de trafic a été observée dès le début de l’année précédente. L’équipe a rapidement identifié une montée en puissance de ces sources, avec une domination très nette de ChatGPT, représentant selon l’intervenante environ 95 % du trafic IA générative observé. Cette évolution a conduit l’équipe à mener des tests manuels à partir de prompts simulant des intentions d’usagers : recherche de concerts le week-end, activités estivales, offres famille, musée, etc.

Ces premiers tests ont mis en évidence plusieurs constats. D’une part, l’institution apparaissait relativement correctement sur les sujets liés aux concerts et spectacles. D’autre part, elle était très peu visible sur d’autres thématiques, notamment le musée. En outre, les réponses générées par les IA renvoyaient fréquemment non pas vers les contenus propres de l’institution, mais vers des agendas en ligne, guides ou intermédiaires éditoriaux. Ce décalage a révélé une limite importante : même lorsqu’une institution est la source primaire de l’information, elle n’est pas nécessairement la source citée ou valorisée.

L’audit a donc été décidé pour plusieurs raisons : objectiver la situation, mesurer la notoriété à un instant T, comparer la visibilité à celle de concurrents, et identifier des bonnes pratiques activables rapidement. Un consensus clair se dégage sur le fait que les outils traditionnels du SEO ne suffisent plus à comprendre ce qui se joue dans les IA génératives. L’intervenante souligne le manque de visibilité sur les requêtes réelles, les mécanismes de citation et les critères de sélection des sources. Roxane Tchernia confirme cette difficulté en rappelant que les usages changent : les utilisateurs n’aboutissent pas toujours à un clic, et l’information peut être consommée directement dans l’interface de l’IA. D’où la nécessité d’anticiper, même si le trafic direct issu des IA reste encore marginal en volume.

Le diagnostic initial stipule ainsi que l’institution disposait déjà d’une base SEO solide, mais l’émergence des IA génératives a révélé de nouvelles zones d’incertitude, notamment sur la visibilité réelle des contenus et sur la capacité à être cité comme source.

Résultats de l’audit : enseignements techniques et éditoriaux

Delphine Anquetil explique que l’audit a d’abord eu un effet rassurant : la visibilité de l’institution dans les environnements IA n’était pas mauvaise à l’instant T. Toutefois, les recommandations formulées ont été nombreuses et structurées autour de deux grands axes : technique et éditorial.

Sur le plan technique, l’un des enseignements les plus marquants est que les recommandations formulées relèvent largement des fondamentaux du SEO classique. L’équipe a ainsi retrouvé des sujets connus : correction d’erreurs 404, amélioration continue des données structurées, qualité du balisage, cohérence des pages. L’intervenante souligne qu’il n’y a pas eu de rupture conceptuelle majeure sur ce volet, mais plutôt une réactivation de l’ensemble des bonnes pratiques, anciennes comme récentes.

L’une des surprises de l’audit réside précisément dans ce retour en force de critères que l’on pensait devenus secondaires, comme le netlinking ou certains éléments de structuration éditoriale. L’impression générale est que, dans l’environnement GEO, toutes les couches historiques du SEO redeviennent pertinentes simultanément. Là où un site à forte autorité pouvait auparavant compenser certaines imperfections locales, l’environnement IA semble exiger un niveau de qualité plus homogène et plus fin.

Sur le plan éditorial, les implications sont plus lourdes. L’institution publie près d’un millier de fiches événements par saison, avec des niveaux de traitement variables selon l’importance des événements. Or, cette volumétrie entraîne mécaniquement des phénomènes de duplication de contenu, de standardisation des chapeaux et de descriptions répétitives. Jusqu’ici, cette situation restait gérable. Désormais, elle devient problématique dans un contexte où les IA semblent plus sensibles à la précision, à la différenciation et à la capacité à répondre à des intentions spécifiques.

Mesure, monitoring et limites des outils actuels

À propos de la difficulté à mesurer l’impact réel des actions engagées, Delphine Anquetil explique que les agences disposent de leurs propres outils de suivi, mais que cela crée une dépendance et ne permet pas à l’institution de piloter seule, de manière continue, l’ensemble de ses thématiques. Le coût d’un audit ou d’un suivi approfondi est significatif, ce qui oblige à faire des choix.

À défaut d’outillage interne stabilisé, l’équipe procède donc à un monitoring manuel : répétition de prompts, observation des réponses, comparaison dans le temps, et surveillance des outils analytics. Cette méthode permet de conserver une forme de vigilance, mais elle est très consommatrice de temps et difficilement généralisable à l’ensemble des sujets stratégiques, notamment au musée. Une autre difficulté majeure réside dans la volatilité des résultats : un même prompt peut produire des réponses différentes. D’où la délicate l’évaluation de l’effet réel d’une optimisation.

Enfin, un signal d’alerte est partagé : le trafic direct issu des IA génératives semble légèrement s’infléchir, mais surtout, le trafic issu des moteurs de recherche classiques baisse lui aussi. Même si l’analyse reste prudente faute de recul, cette évolution est jugée préoccupante et renforce le sentiment d’urgence.

La mesure de la performance GEO est donc encore imparfaite, coûteuse et instable, qui plus est dans un contexte d’incertitude méthodologique. Roxane Tchernia résume ce changement de paradigme : ce que l’on mesurait auparavant n’a peut-être plus le même sens, puisque les utilisateurs peuvent obtenir une réponse sans cliquer. La question n’est donc plus seulement l’acquisition de trafic, mais aussi la présence informationnelle dans des environnements intermédiaires. Delphine Anquetil exprime aussi une inquiétude opérationnelle : sans data scientist en interne et sans outil dédié, l’organisation avance “avec ses petites mains”. Cette formule traduit une tension entre l’importance stratégique du sujet et les moyens disponibles pour le traiter.

Évolutions stratégiques : contenus, expérience utilisateur et organisation interne

La discussion se poursuit sur les conséquences stratégiques et organisationnelles du GEO. Delphine Anquetil explique que ces réflexions dépassent le seul cadre du référencement. Elles interrogent la manière même de présenter l’offre, notamment pour les activités pérennes comme le musée ou la Philharmonie des enfants.

La discussion fait également émerger les effets internes de ces transformations : le sujet déborde le périmètre de l’équipe numérique. Les enjeux concernent aussi la communication, les partenariats, la médiation, la rédaction et plus largement l’expérience utilisateur. Le GEO ne doit pas être pensé uniquement comme une technique d’acquisition, mais comme une réflexion plus large sur la présence, la notoriété et la qualité de l’expérience proposée.

La tension principale réside dans l’arbitrage entre adaptation aux logiques algorithmiques et fidélité au projet culturel. Comment rendre l’offre plus “lisible” pour les IA sans l’appauvrir ? Comment proposer des parcours plus expérientiels sans réduire la programmation à quelques produits vedettes ? Ces questions restent ouvertes, mais elles structurent désormais la réflexion.

Réseaux sociaux, Markdown/LLM, souveraineté des contenus

Les échanges entre participants élargissent le champ de réflexion. Une participante partage d’abord une veille indiquant que les IA génératives iraient chercher de plus en plus d’informations sur les réseaux sociaux. Elle attire l’attention sur les métadonnées des photos publiées sur ces plateformes et s’interroge sur les bonnes pratiques à adopter : description purement visuelle ou métadonnées plus orientées usage et intention.

Un autre échange porte sur l’intérêt éventuel d’ajouter, sur un site WordPress ancien, un plugin Markdown ou des dispositifs de type llm.txt pour faciliter la lecture des contenus par les modèles de langage. La discussion reste prudente. D’un côté, ces formats pourraient simplifier l’accès des IA au contenu textuel. De l’autre, plusieurs réserves sont formulées : caractère encore émergent de ces pratiques, risque de duplication de contenu, facilitation du scraping, et enjeux de souveraineté informationnelle.

Le débat met ainsi en lumière une tension structurante : faut-il rendre ses contenus plus facilement exploitables par les IA pour gagner en visibilité, au risque de faciliter leur réutilisation par des tiers ? Aucun consensus opérationnel n’émerge, mais le sujet est reconnu comme stratégique.

Pour aller plus loin

Rendez-vous sur notre plateforme d’auto-formation Audience Data & Performing Arts sur la fiche Mettre en oeuvre une stratégie SEO : le minimum, le réaliste : n’hésitez pas à en proposer des enrichissements !